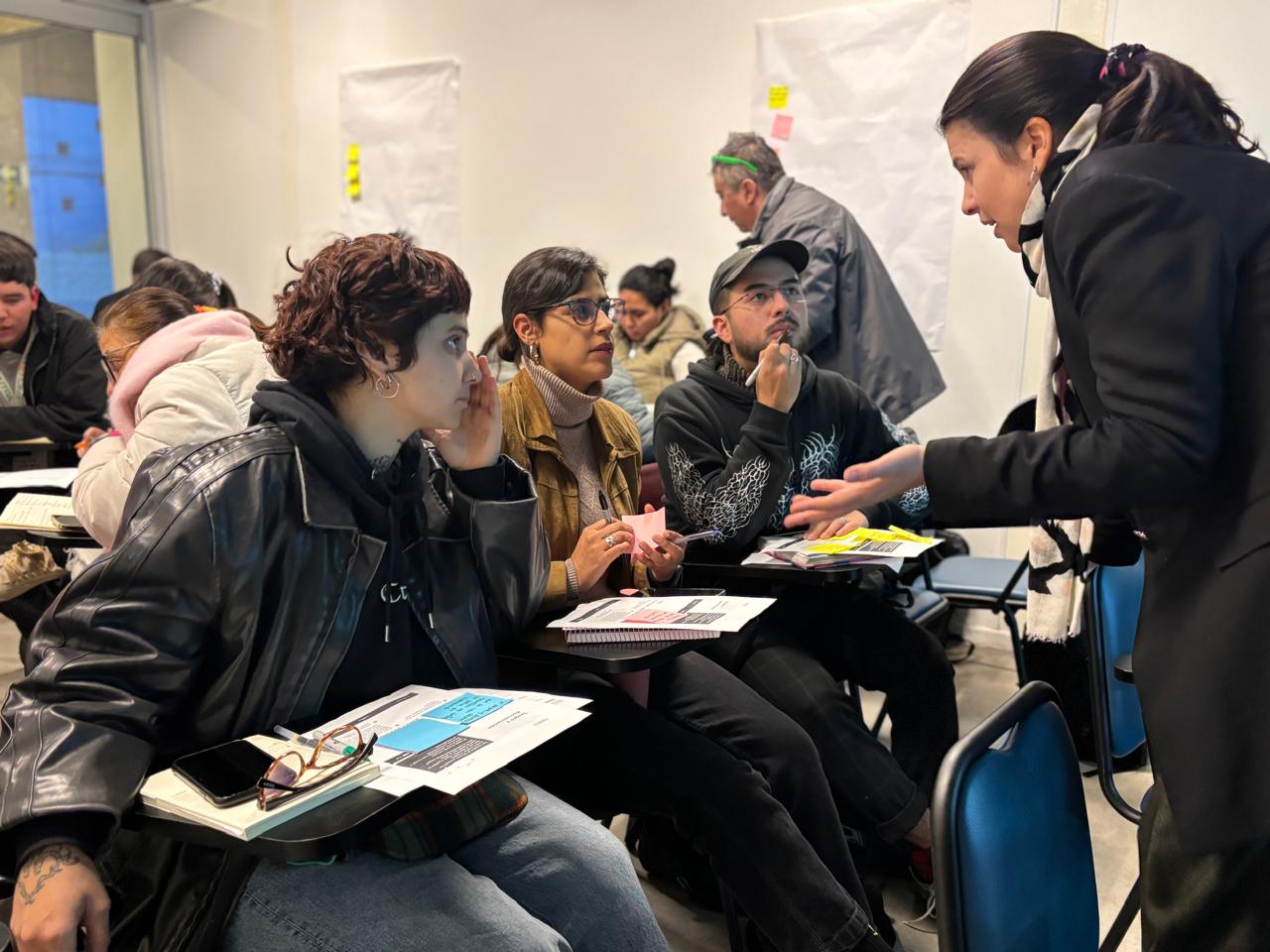

María Paz Hermosilla, directora del GobLab, habla aquí sobre los principales resultados del estudio sobre transparencia algorítmica y la importancia de la participación de la UAI en este encuentro.

GobLab UAI y CPLT presentan investigación en conferencia internacional sobre uso responsable de la inteligencia artificial

20 de julio 2023

¿Por qué es importante impulsar el uso adecuado de la inteligencia artificial? ¿Cuáles son los riesgos de no hacerlo? Estas son algunas de las interrogantes que abordó la última conferencia académica internacional sobre ciencias de la computación ACM FAccT 2023, la más importante en el tema del uso responsable de la inteligencia artificial y un encuentro interdisciplinario cuyo objetivo fue reunir a investigadores y profesionales interesados en la equidad, la responsabilidad y la transparencia de los sistemas socio-técnicos.

Este año ACM FAccT se realizó en Chicago, EE.UU., donde un equipo del GobLab, laboratorio de innovación pública de la Escuela de Gobierno de la UAI, fue invitado a presentar la investigación “Algorithmic Transparency from the South” sobre transparencia algorítmica en el sector público, desarrollada en colaboración con el Consejo para la Transparencia (CPLT). Esta investigación sirvió de base para el desarrollo de la que será la primera Instrucción General de Transparencia Algorítmica de Latinoamérica, normativa que está elaborando el Consejo para la Transparencia con la asesoría del proyecto Algoritmos Éticos de la UAI y el apoyo del Bid Lab.

Conversamos con María Paz Hermosilla, directora del GobLab UAI y quien presentó el paper en ACM FAcct 2023, sobre los hallazgos de esta investigación, el concepto de transparencia algorítmica y la importancia de la participación de la UAI en esta conferencia.

-¿En qué consiste esta conferencia y por qué es importante?

ACM FAccT es una conferencia interdisciplinar que reúne una comunidad diversa de investigadores y profesionales de las ciencias de la computación, el derecho, las ciencias sociales y las humanidades interesados en la equidad, responsabilidad y transparencia de sistemas de algoritmos e inteligencia artificial. Se ha realizado 6 veces a partir del 2018.

-¿Cuáles son los principales resultados de la investigación que presentaste?

La investigación presenta los resultados y conclusiones del estudio sobre transparencia algorítmica en la administración pública y el uso de sistemas automatizados de decisión en el Estado de Chile, realizado por el GobLab en alianza con el Consejo para la Transparencia de Chile, en un equipo liderado por Romina Garrido e integrado por Pablo Lapostol y por mí. Se realizó una encuesta a más de 800 organismos públicos para averiguar en qué políticas públicas se utilizaban algoritmos para la toma de decisiones, un análisis de transparencia a un subconjunto de los sistemas identificados y un estudio de cómo podría integrarse la transparencia algorítmica en la regulación del país. Los resultados de la investigación muestran, primero, que existe un uso de sistemas de decisión automatizados en operaciones críticas en el sector público chileno que presenta altos niveles de opacidad, y que el marco legal actual permite la implementación de una norma de transparencia algorítmica para la administración pública de forma flexible, escalada y con criterios que permitan a los ciudadanos evaluar su interacción con estos sistemas. A partir de los resultados de esta investigación, y en el marco del proyecto Algoritmos Éticos que ejecuta la UAI con apoyo del BID Lab, el año pasado junto al Consejo de Transparencia desarrollamos un borrador de la Instrucción General de Transparencia Algorítmica y la piloteamos con siete algoritmos de cuatro organismos públicos. En 2023 está prevista una consulta pública y luego la publicación de la norma definitiva, la que será la primera de América Latina en regular esta materia.

-¿El impacto e importancia de la presencia del GobLab UAI en este encuentro?

Esta es la conferencia académica más importante en el tema de uso responsable de la inteligencia artificial, y es muy competitiva. Para esta edición solo aceptaron a un 25% de los postulantes, por lo que estamos orgullosos de realizar un trabajo de calidad mundial. Pudimos dar a conocer nuestro trabajo entre académicos muy influyentes y visibilizar los logros que estamos teniendo en Chile. Después de la presentación se nos acercaron investigadores, funcionarios públicos y periodistas que estaban interesados en nuestro trabajo, precisamente porque no es sólo una publicación académica, sino que tiene una incidencia en la gobernanza de los algoritmos en el sector público.

– ¿Qué es la transparencia algorítmica?

La transparencia algorítmica es proporcionar a las personas la información necesaria para evaluar e interactuar con los algoritmos, para prevenir que estos produzcan resultados injustos, arbitrarios o que afecten derechos fundamentales.

-¿Por qué es necesaria e importante?

Es necesaria e importante porque los algoritmos están participando en decisiones relevantes que toman los organismos públicos, como apoyar la detección de enfermedades, asignar niños y niñas a establecimientos educacionales o seleccionar empresas para fiscalizar el cumplimiento de la normativa laboral. Tenemos 75 casos de sistemas automatizados o semi-automatizados implementados en el Estado de Chile en el Repositorio Algoritmos Públicos, que recientemente ganó el premio latinoamericano a la democracia digital.

-¿Tú opinión sobre el estado de la transparencia algorítmica en LATAM?

En este momento hay muy poca transparencia algorítmica en Latinoamérica. La estrategia de inteligencia artificial del Uruguay incluye un observatorio de IA en el sector público, que debiera publicarse en el segundo semestre de este año. En Colombia, el gobierno anterior publicó un portal donde tenían fichas con información sobre unos pocos sistemas. Chile es el único que está trabajando en una normativa sobre la materia para el sector público. Existen esfuerzos de transparencia algorítmica desde la academia y sociedad civil, como nuestro Repositorio de Algoritmos Públicos, una base de datos sobre sistemas automatizados en la administración pública colombiana que publicó la Universidad del Rosario en Colombia y la Fundación Derechos Digitales ha investigado casos implementados en diferentes países son su proyecto de inclusión e IA.

-¿Desafíos del sector público en temas de transparencia algorítmica?

Los desafíos que enfrenta el sector público en materia de transparencia algorítmica son en primer lugar una falta de conocimiento en las y los funcionarios públicos sobre qué son los algoritmos y cómo funcionan. Para poder elaborar la información a transparentar sobre los algoritmos, se requerirá un trabajo interno coordinado, entre las áreas de procesos que usan los algoritmos, y los equipos técnicos que los desarrollan (sean internos o externos) y los encargados de transparencia activa que publicarán la información. Un desafío adicional es que es un tema donde existe un lenguaje bastante técnico y si queremos que haya transparencia debemos explicarlo en lenguaje claro para las personas. En aspectos más de fondo será muy necesaria la sensibilización, puesto que las resistencias a mayor apertura de información constituyen una realidad. Esto debe incluir el alineamiento de esta iniciativa con políticas gubernamentales más amplias como la Estrategia Nacional de IA.